Представьте, что вы выбираете маршрут в навигаторе. Один путь — 5 км по пробкам, другой — 10 км по свободной трассе. Какой быстрее? Ответ зависит не только от расстояния, но и от условий. Big O нотация — это такой же «навигатор» для программистов, который показывает, как поведёт себя алгоритм при росте данных. Не пугайтесь математических символов — за ними скрывается простая логика оценки эффективности кода.

Что такое Big O на самом деле?

Big O (или «О большое») — это математическая запись, описывающая верхнюю границу времени выполнения или использования памяти алгоритмом при увеличении объёма входных данных (обозначается как n). Ключевая идея: нас интересует не точное время в миллисекундах, а характер роста.

Big O описывает худший сценарий работы алгоритма. Это пессимистичная, но безопасная оценка.

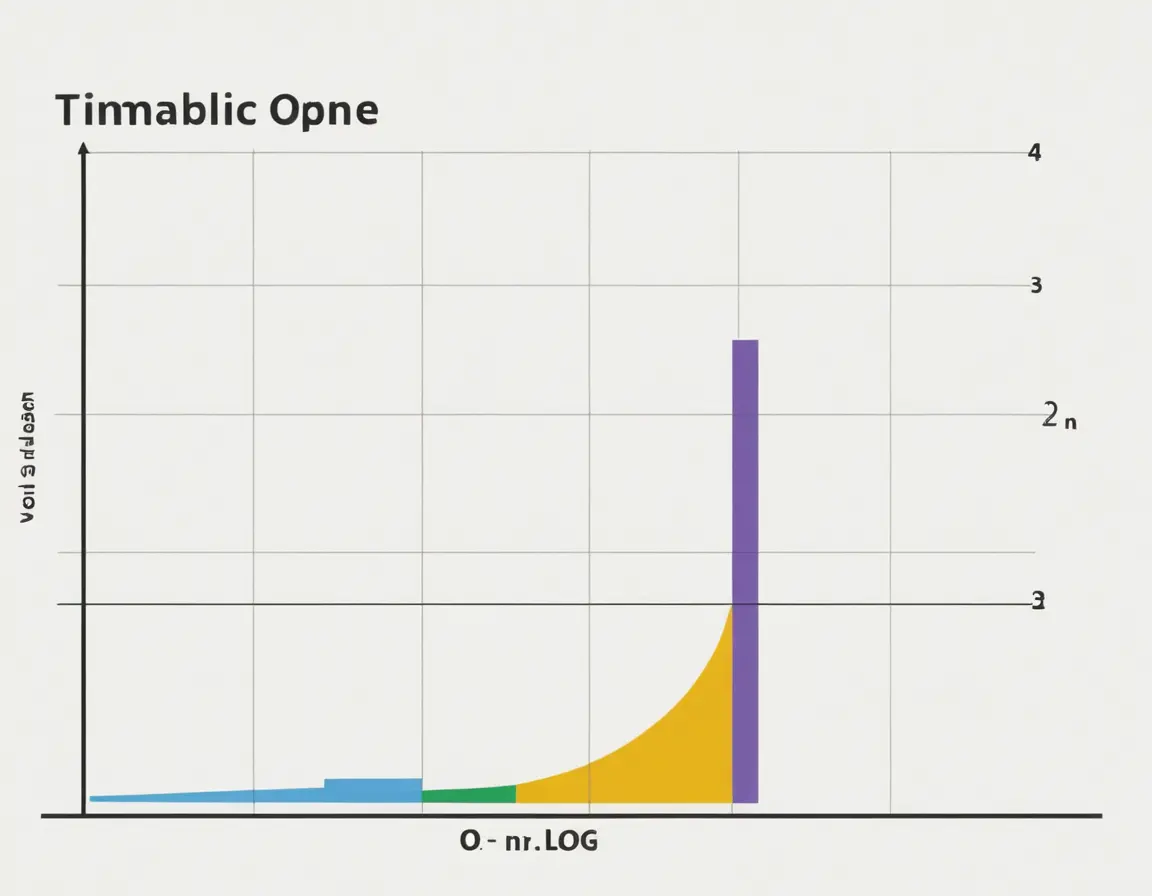

Основные сложности: от лучших к худшим

Рассмотрим основные варианты по возрастанию «дороговизны».

O(1) — Константная сложность (Идеал)

Время выполнения не зависит от размера данных. Пример — доступ к элементу массива по индексу. 10 элементов или 10 миллионов — операция занимает одно и то же время.

O(log n) — Логарифмическая сложность (Отлично)

Время растёт медленнее, чем сами данные. Классический пример — бинарный поиск в отсортированном массиве. Каждый шаг уменьшает зону поиска вдвое.

O(n) — Линейная сложность (Хорошо)

Время растёт прямо пропорционально n. Пример — поиск элемента в неотсортированном массиве перебором (в худшем случае). 1000 элементов — 1000 проверок.

На практике O(n) часто является приемлемым компромиссом между простотой реализации и производительностью.

O(n log n) — Линейно-логарифмическая сложность (Нормально для сортировок)

Характерна для эффективных алгоритмов сортировки, таких как быстрая сортировка (QuickSort) или сортировка слиянием (MergeSort). Работают значительно лучше, чем квадратичные.

O(n²) — Квадратичная сложность (Плохо)

Время растёт пропорционально квадрату размера данных. Классический пример — два вложенных цикла по тому же массиву (пузырьковая сортировка). При увеличении данных в 10 раз время работы увеличится примерно в 100 раз.

O(2ⁿ) и O(n!) — Экспоненциальная и факториальная (Катастрофа)

Такие алгоритмы становятся невыполнимыми даже при относительно небольших n. Пример — решение задачи коммивояжёра полным перебором (O(n!)).

Как это работает на практике? Простой пример

Допустим, у нас есть массив чисел, и мы хотим найти пару, дающую в сумме 10.

- Наивный способ (O(n²)): Взять первый элемент, сложить со вторым, потом с третьим... Затем повторить для второго элемента и так далее. Два вложенных цикла.

- Оптимизированный способ (O(n)): Пройти по массиву один раз, для каждого числа вычисляя, какое второе число нам нужно (10 - текущее_число), и проверяя его наличие в хэш-таблице (операция ~O(1)).

При 1 000 000 элементов разница будет колоссальной: минуты/часы против доли секунды.

Что упрощать, а что игнорировать? Правила упрощения

Big O оценивает тренд при очень больших n. Поэтому:

- Константы отбрасываются: O(2n) → O(n), O(500) → O(1).

- Остаётся самый быстрорастущий член: O(n² + n) → O(n²). При огромных n слагаемое n становится незначимым.

- Параметры разные — указываем все: Если алгоритм обрабатывает матрицу размера n×m, сложность будет O(n*m).

Пространственная сложность

Big O может описывать не только время, но и память, которую использует алгоритм. Например, сортировка слиянием имеет сложность O(n log n) по времени, но O(n) по памяти (требуется дополнительный массив).

Часто существует компромисс (trade-off) между временной и пространственной сложностью: можно ускорить алгоритм, используя больше памяти (кэши, хэш-таблицы).

FAQ: Часто задаваемые вопросы

Зачем это нужно, если компьютеры быстрые?

При работе с большими данными (Big Data, базы данных, видеопотоки) разница между O(n) и O(n²) — это вопрос между работой системы и её полным зависанием. Неэффективный алгоритм «съест» все преимущества мощного железа.

Всегда ли нужно стремиться к самой низкой сложности?

Нет. Если вы пишете скрипт для обработки 100 строк раз в день, важнее читаемость и скорость разработки. Оптимизируют «узкие места» (bottlenecks), выявленные при профилировании. Но понимание сложности помогает не написать катастрофически медленный код с самого начала.

Как определить сложность своего алгоритма?

1. Посчитайте, сколько основных операций (сравнений, присваиваний) выполняется в зависимости от размера ввода (n).

2. Найдите самую быстрорастущую функцию.

3. Упростите выражение по правилам Big O.

Почему это называется «О большое»?

Буква O используется, потому что скорость роста функции называют также её «порядком» (Order of growth). Это часть более широкой математической системы «асимптотических обозначений» Ландау.